| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

- vue.js

- 파이토치

- Deep Learning

- 논문 리뷰

- Docker

- MariaDB

- pytorch

- POD

- FLASK

- yaml

- 텐서플로우

- numpy

- 그래픽 유저 인터페이스

- 데이터베이스

- Django

- Computer Vision

- 컴퓨터 비전

- Python

- 딥러닝

- tensorflow

- Tkinter

- 파이썬

- GUI

- paper review

- 장고

- Web Programming

- kubernetes

- k8s

- OpenCV

- 웹 프로그래밍

- Today

- Total

목록파이토치 (7)

Maxima's Lab

안녕하세요, 오늘은 딥러닝에서 Normalization (정규화)에 대해서 알아보겠습니다. 딥러닝에서 Normalization은 입력 데이터를 조정하여 모델의 학습 성능을 개선하는 방법 중 하나입니다. 여러 종류의 Normalization 기법이 있으며, 가정 널리 사용되는 종류들은 다음과 같습니다. Batch Normalization (BN) : 각 미니배치의 입력 데이터를 정규화하여 평균과 분산을 조정하는 방법입니다. 이를 통해 학습 도중 발생하는 Internal Covariate Shift를 줄일 수 있으며, 더욱 안정적인 학습이 가능해집니다. Layer Normalization (LN) : BN과 유사하지만, 전체 미니배치 대신 레이어 내에서 평균과 분산을 계산하여 정구화하는 방법입니다. BN에 ..

[Paper Review (논문 리뷰)] Aggregated Residual Transformations for Deep Neural Networks (RexNext) + 코드 구현

[Paper Review (논문 리뷰)] Aggregated Residual Transformations for Deep Neural Networks (RexNext) + 코드 구현

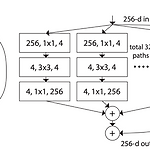

안녕하세요, 오늘은 Aggregated Residual Transformations for Deep Neural Networks (https://arxiv.org/pdf/1611.05431.pdf) 위 논문에 대해서 리뷰를 해보고 해당 모델에 대해서 구현해보도록 하겠습니다. RexNeXt는 ResNet의 성능을 개선하기 위해 ResNet과는 다른 방식으로 모델을 구성하였습니다. 이를 위해 ResNet에서 사용된 residual block을 확장하여, 여러 개의 경로를 사용하는 모델 아키텍처인 ResNeXt를 제안하였습니다. RexNeXt의 핵심 아이디어는 Cardinality 입니다. Carninality는 ResNeXt에서 레이어 마다 입력 데이터를 여러 개의 경로로 보내는 개념을 나타냅니다. 예를 들..

[Paper Review (논문 리뷰)] Attention U-Net: Learning Where to Look for the Pancreas & 코드 구현

[Paper Review (논문 리뷰)] Attention U-Net: Learning Where to Look for the Pancreas & 코드 구현

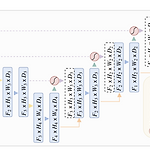

안녕하세요, 오늘은 Attention U-Net: Learning Where to Look for the Pancreas (https://arxiv.org/pdf/1804.03999.pdf) 위 논문에 대해서 리뷰를 해보도록 하겠습니다. 먼저 Attention U-Net의 전체 구조는 다음과 같습니다. Attention U-Net 모델은 U-Net 아키텍처를 기반으로 하면서, Decoder에서 Attention 메커니즘을 사용하여 성능을 향상시킨 딥러닝 모델입니다. U-Net 모델은 Encoder와 Decoder로 구성되어 있으며, 인코더에서는 이미지를 축소해가며 특성을 추출하고, Decoder에서는 이러한 특성을 기반으로 이미지를 확대하여 Segmentation Mask를 생성합니다. Attention..

[Python, Pytorch] torchvision.transforms 사용법

[Python, Pytorch] torchvision.transforms 사용법

안녕하세요, 오늘은 Pytorch 내 torchvision.transforms에 대해 알아보도록 하겠습니다. transforms 내 알아볼 내용들은 다음과 같습니다. CenterCrop RandomCrop Resize RandomVerticalFlip & RandomHorizontalFlip 아래의 Original Image에 대해 적용해보도록 하겠습니다. 위의 이미지는 (256, 256, 3) Shape을 지니고 있는 이미지입니다. 먼저, (200, 200, 3) Shape로 Center Crop을 적용해보겠습니다. import torch import torchvision.transforms as transforms transforms = transforms.Compose( [transforms.ToT..

안녕하세요, 오늘은 Pytorch 내 Tensor와 Cuda 사용법에 대해서 알아보도록 하겠습니다. Tensor 및 Cuda 사용법에 대한 내용은 다음과 같습니다. torch.tensor() torch.as_tensor() size() dtype device unsqueeze() & squeeze() permute() & transpose() 다음은 Tensor와 Cuda를 사용하기 전 Cuda와 관련된 상태를 알아보는 코드입니다. import torch print(torch.cuda.is_available()) print(torch.cuda.current_device()) print(torch.cuda.device_count()) print(torch.cuda.get_device_name(0)) 위의 ..

안녕하세요, 오늘은 Pytorch 내 TensorDataset과 DataLoader에 대해 알아보도록 하겠습니다. 코드를 구현하기 위한 과정은 다음과 같습니다. 임의의 numpy.narray 타입의 데이터 셋 생성(train_x, train_y) numpy.narray 타입의 데이터 셋을 torch.Tensor 타입으로 변환 TensorDataset을 이용하여 데이터 셋 구성 DataLoader를 이용하여 Batch로 구성 위의 과정에 대해 전체 코드는 다음과 같습니다. import torch from torch.utils.data import TensorDataset, DataLoader import numpy as np train_x = np.random.randint(0, 256, (64, 3, 2..

안녕하세요, 오늘은 Pytorch 내 DataLoader (데이터 셋 불러오기)에 대해서 알아보겠습니다. torchvision.datasets 내 데이터 셋 예시들 중 CIFAR10를 활용해서 진행해보도록 하겠습니다. import torch import torchvision import torchvision.transforms as transforms import numpy as np transform = transforms.Compose( [transforms.ToTensor()]) train_dataset = torchvision.datasets.CIFAR10(root='./data', train=True, download=True, transform=transform) print(train_data..