| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | ||||

| 4 | 5 | 6 | 7 | 8 | 9 | 10 |

| 11 | 12 | 13 | 14 | 15 | 16 | 17 |

| 18 | 19 | 20 | 21 | 22 | 23 | 24 |

| 25 | 26 | 27 | 28 | 29 | 30 | 31 |

- 딥러닝

- Docker

- 데이터베이스

- GUI

- 논문 리뷰

- Deep Learning

- numpy

- 파이토치

- Web Programming

- 컴퓨터 비전

- paper review

- 웹 프로그래밍

- pytorch

- MariaDB

- Django

- POD

- vue.js

- Computer Vision

- 텐서플로우

- OpenCV

- k8s

- kubernetes

- yaml

- 그래픽 유저 인터페이스

- 파이썬

- tensorflow

- FLASK

- 장고

- Tkinter

- Python

- Today

- Total

목록텐서플로우 (8)

Maxima's Lab

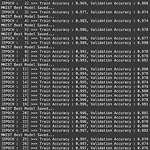

[Python, Tensorflow] Custom Callback 만들기 (Classification)

[Python, Tensorflow] Custom Callback 만들기 (Classification)

안녕하세요, 오늘은 Tensorflow 2에서 Classification 모델 학습 시 Callback을 Customize 하는 방법에 대해서 알아보겠습니다. MNIST 데이터 셋을 활용하여, 모델 학습하는 예시 입니다. import tensorflow as tf from tensorflow.keras.datasets import mnist from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Flatten, Dense from tensorflow.keras.callbacks import Callback import numpy as np class SimpleCallBack(Callback): def __ini..

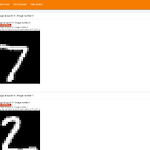

[Python, Tensorflow] Tensorboard 내 이미지 추가 방법 (Classficiation)

[Python, Tensorflow] Tensorboard 내 이미지 추가 방법 (Classficiation)

안녕하세요, 오늘은 Tensorboard 내 학습 중 사용하는 Images를 추가하는 방법에 대해서 알아보겠습니다. 전체 코드는 다음과 같습니다. import tensorflow as tf from tensorflow import keras import numpy as np import datetime class CustomImageLogger(tf.keras.callbacks.Callback): def __init__(self, log_dir, validation_data, num_images=3): super().__init__() self.log_dir = log_dir self.num_images = num_images self.validation_data = validation_data def ..

[Deep Learning (딥러닝)] Label Smoothing 개념 + Tensorflow 2 적용

[Deep Learning (딥러닝)] Label Smoothing 개념 + Tensorflow 2 적용

안녕하세요, 오늘은 Label Smoothing의 개념에 대해서 알아보고 알아보겠습니다. Label Smoothing (라벨 스무딩)이란, 딥러닝 분류 모델을 학습 시 사용하는 정규화 기법이며, 모델 학습 시 과확신을 방지하기 위해 사용합니다. 이를 위해 다음과 같이 One-Hot Encoding Labeling을 조정하게 됩니다. (Ex) : [1, 0, 0, 0, 0] ==> [0.8, 0.05, 0.05, 0.05, 0.05] 위와 같이 적용하기 위해서는 Categorical Crossentropy 함수를 수정해야 합니다. def label_smoothing_loss(y_true, y_pred, label_smoothing=0.1): num_classes = tf.cast(tf.shape(y_tru..

안녕하세요, 오늘은 딥러닝에서 Normalization (정규화)에 대해서 알아보겠습니다. 딥러닝에서 Normalization은 입력 데이터를 조정하여 모델의 학습 성능을 개선하는 방법 중 하나입니다. 여러 종류의 Normalization 기법이 있으며, 가정 널리 사용되는 종류들은 다음과 같습니다. Batch Normalization (BN) : 각 미니배치의 입력 데이터를 정규화하여 평균과 분산을 조정하는 방법입니다. 이를 통해 학습 도중 발생하는 Internal Covariate Shift를 줄일 수 있으며, 더욱 안정적인 학습이 가능해집니다. Layer Normalization (LN) : BN과 유사하지만, 전체 미니배치 대신 레이어 내에서 평균과 분산을 계산하여 정구화하는 방법입니다. BN에 ..

오늘은 Tensorflow 2 모델(.h5)을 .onnx 모델로 변환하는 방법에 대해서 알아보도록 하겠습니다. import tensorflow as tf from tensorflow.keras.models import load_model model = load_model("model.h5") 먼저, .h5 모델을 로드 합니다. 이어서 .onnx 파일로 변환하기 위해 tf2onnx 패키지를 설치합니다. pip install -U tf2onnx 패키지를 설치 후 다음 명령어를 통해 .onnx 모델로 변환합니다. python -m tf2onnx.convert --input model.h5 --output model.onnx --opset 13 위의 명령어에서 Opset은 ONNX에서 지원하는 연산의 집합을 의..

안녕하세요, 오늘은 Tensorflow 내 tensorflow.keras.metrics 함수들에 대해서 알아보겠습니다. tensorflow.keras.metrics 내 사용해볼 함수들은 다음과 같습니다. Mean() : 주어진 값들에 대해 평균값을 계산하며, 주로 update_state, reset_state, result 함수를 호출 SparseCategoricalAccuracy() : 정수값과 대응되는 Logit의 argmax값의 정확도를 계산하며, 유사하게 update_state, reset_state, result 함수를 호출 먼저, Mean() 함수에 대해서 알아보겠습니다. import tensorflow as tf mean = tf.keras.metrics.Mean() print(mean.re..

오늘은 Tensorflow 내 Math 함수들에 대해서 알아보겠습니다. tensorflow.math 내 사용해 볼 함수들은 다음과 같습니다. tf.reduce_max(), tf.reduce_mean(), tf.reduce_min() : Tensor 내 특정 축(axis)를 기준으로 각각 최대값, 평균값, 최소값을 Tensor로 반환 tf.reduce_prod(), tf.reduce_sum() : Tensor 내 측정 축(axis)를 기준으로 각각 곱하는(더하는) 연산을 하여 Tensor로 반환 # tf.reduce_max(), tf.reduce_mean(), tf.reduce_min() x = tf.constant([[1.0, 0.5, -5.0, 5.0], [0.5, 7.0, -3.0, -9.0]]) p..

오늘은 Tensorflow 내 Math 함수들에 대해서 알아보겠습니다. tensorflow.math 내 사용해 볼 함수들은 다음과 같습니다. tf.abs() : Tensor 내 각 성분들의 절대값을 계산하여 Tensor로 반환 tf.add() : 서로 다른 두 Tensor들의 각 성분들을 더하여 Tensor로 반환 tf.multiply() : 서로 다른 두 Tensor들의 각 성분들을 곱하여 Tensor로 변환 tf.argmax(), tf.argmin() : Tensor 내 특정 축(axis)를 기준으로 각각 최대값과 최소값의 인덱스들을 찾아 Tensor로 반환 # tf.abs() import tensorflow as tf x = tf.constant([-1.5]) print(tf.abs(x)) tf.T..